Interaktivität

- Wer mit Wem ?

Theorien

zur Interaktivität & Interpassivität

Stephan (Spiv) Schröder

spiv@hgb-leipzig.de

Dezember 1999 - Januar 2000

(vorübergehend endgültig)

Diese Arbeit wurde im Rahmen des Seminars

"INTER: Interaktivität, Internet & Interferenz mit intermedialer

Kunst" an der

Hochschule für Grafik und Buchkunst / academy of visual arts / Leipzig

erstell.

(Leitung Prof. Dieter Daniel & Joachim Blank)

DOWNLOAD DOKUMENT: MS WORD HTML

(MIT BILDMATERIAL)

INHALT

BEGRIFFLICHKEITEN

Interaktion

Kommunikation

Kommunikation mit Maschinen

Intelligenz

künstliche IntelligenzKeine Interaktivität - warum ? / Thesen der Ursache von Interpassivität

Turings's Erben / KI -künstliche Intelligenz oder künstlicher Idiot ?

Interaktion,

das ist

zunächst einmal kein neuzeitlich technologischer Begriff, sondern hat

seinen Ursprung in der Soziologie und Psychologie. Er beschreibt die Wechselbeziehung,

einschließlich der Kommunikation, zwischen Individuen innerhalb einer

Gruppe.

Die Verschleppung

der Begrifflichkeiten Interaktion und Interaktivität in den technologischen

Bereich, fusst auf dem Traum von der Schaffung künstlicher Intelligenz.

Auf dem beharrlichen Mensch – Maschine Vergleich, der Vision vom digitalen

Menschenabbild, bei deren Verwirklichung berechtigtermassen Soziologie

und Technologie zusammenfallen würden. Doch soweit sind wir noch lange

nicht.Die Euphorie der Pioniere der Computerentwicklung, ist angesichts

der anhaltend rasanten Entwicklung ungebrochen, während die KI-Forschung

in den letzten Jahrzehnten vergleichsweise wenig signifikante Erfolge

verbuchen konnte. Es liegt also auf der Hand, dass man nicht etwa die

Computerentwicklung überschätzte, sondern die Leistung des menschlichen

Gehirns unterschätzte.

Die Wechselbeziehung

von Individuen der Gattung „homo sapiens“ (Mensch <=> Mensch),

ist seit Jahren fester und unbestritten elementarer Bestandteil der Soziologie.

Dem Interagieren zwischen Computersystemen (Maschine <=>

Maschine) hat sich die, noch recht junge, Wissenschaft der Sozionik &

Robotnik verschrieben.

Was uns heute

die Begriffsfindung von „Interaktivität“ schwer macht, ist das Subsumieren

von Maschine und Mensch (Mensch <=> Maschine (<=>

Mensch)) . Daher möchte ich in dieser Arbeit überwiegend die

Grenzwerte und die Trennschärfe dessen beleuchten, was wir gemeinhin als

Mensch <=> Maschine Interaktion verstehen und nur

am Rande auf die reinen soziologischen bzw. technologischen Gegenpole

eingehen. Die reinen Gegenpole, d.h. Mensch<=> (mittels

Maschine)<=> Mensch, wie wir sie in kollektiven Strukturen

Chats, Communities oder Foren finden, und Maschine <=>

Maschine Interaktion, stellen auch nicht zwingend die Frage „Wer

mit wem ?“ - sondern eher die Frage nach dem „Wie“. Wobei „Wie“ auf ein

operatives Verständnis zielt, also wie wir miteinander durch Maschinen

interagieren und wie uns das verändert. Auf diese soziologischen

Termini soll ebenfalls nur peripher eingegangen werden.

Kommunikation,

ist für uns ein wichtiger Faktor für Interaktivität, zugleich aber

einer ihrer gröbsten Widersacher, denn Kommunikation ist selbst in der

zwischenmenschlichen Variante mit enormen Datenverlust und Datenverfremdung

verbunden.

Die Kommunikationspartner

bedienen sich beim Gedankenaustausch der gesprochenen oder geschrieben

Sprache, Mimik, Gestik oder anderer bildnerischer Hilfsmittel. Dabei muss

zunächst einmal der zutransportierende Gedanke vom Sender für die „Übertragung“

aufbereitet werden und sich dem Diktat der zuvor genannten Hilfsmittel

unterwerfen, was zu einer Reduktion und zu einer ersten Verfremdung des

Originalgedankens führt. Dabei scheint die menschliche Sprache ein sehr

reduziertes „Protokoll“ darzustellen, was Aussagen wie „mir fehlen die

Worte“ oder „ein Bild sagt mehr als 1000 Worte“ bestätigen.

Der nun für

die Übertragung komprimierte Gedanke in Wort- oder Bildgestalt, wird beim

Empfänger wieder zu Gedanken in Form einer Vorstellung oder Vision decodiert.

Ob diese Vision dem Originalgedanken entspricht ist kaum bis gar nicht

zu verifizieren, logisch bleibt jedoch aus Erfahrungswerten, das die kurzmöglichste

Kommunikationskette, zum Beispiel die direkte Gedankenübertragung mittels

Telepathie, die auf theoretischer Basis, verlustfreiste Kommunikation

wäre. Der „Verlust“ an sich, lässt sich aufgrund des unmöglichen Vergleichs

von Original und Zielgedanken nicht messbar erfassen, wird aber beim direkten

Vergleich der Übertragungmittel erahnbar. Beispielsweise gehen Schrift

(Buch) und dazu erschienendes Bild (Film) im Zielgedanken des Rezipienten

oft getrennte Wege, weil Schrift mehr Interpretationsraum bietet. Unter

der Prämisse, dass Autor und Regisseur die selbe Person sind , also auch

denselben Originalgedanken transportieren wollen, wäre also Schrift gegenüber

dem Bild als verlustreicher zu werten. (siehe auch oben „Ein Bild sagt

mehr als 1000 Worte“).

Der Psychologe Wrazlavik bemerkt: „Man kann nicht nicht kommunizieren.“ [1]

Selbst ein Schweigen trägt innerhalb des gegebenen Kontexts, Information in sich. Der „Idealkommunikation“ müsste neben einer telepathischen Übertragung, also auch eine Gleichschaltung des Kontextverständnisses einhergehen. Das mag man als Techno-Faschismus als Anti-Individualismus interpretieren, einer Fehlkommunikation wirkt es entgegen. Bis dahin werden wir unser Gedankengut weiterhin der Zensur unserer eigenen Sprache unterwerfen müssen..

Zu den Diskrepanzen unserer zwischenmenschlichen Kommunikation, gesellt

sich bei der

Kommunikation

mit Maschinen

ein weiteres

Verständigungsproblem hinzu. Der Mensch versteht die Computersprache nicht,

genauso wenig wie Computer die komplexe menschliche Linguistik nicht verstehen.

Beide Kommunikationspartner brauchen einen Dolmetscher, in Programmierkreisen

Interpreter genannt, der die in abstrakter Menschensprache eingegebenen

Befehle in computerverständlichen Bytecode übersetzt (compile). Retrospektive

wird der Computer dahingehend programmiert – das Ergebnis dieser Kommunikation

auf, für den Menschen wahrnehmbaren Devices wie Monitor, Musikboxen oder

ForceFeedback Systemen auszugeben. Ein Missverständnis bei der, zusätzlich

des Geruchs- und Geschmacksinns beraubten Kommunikation, ist dabei verständlichermaßen

nicht gerade selten und führt zu einem Fehler bzw. unvorhersehbaren Ausgaben.

Peter

Glaser schreibt zur zwischenmenschlichen Interaktion:

„Es liegt

in der Natur der Sache, dass sich ein Gegenüber, mit dem ich auf die altbekannt

analoge Art interaktiv bin, gleichzeitig mit mir ändert – jede Seite wird

etwas erfahrener. Die Situation ist nie eindeutig vorhersehbar.“ [2]

Ich vertrete ebenfalls diese Meinung, und möchte weiterhin behaupten,

daß im gleichen Maße die digitale Unvorhersehbarkeit als ein wesentlicher

Schritt in Richtung „Interaktivität mit Maschinen“ angesehen werden kann.

Der Programmfehler

ist die Emmanzipation des Computers, ist das Aufbrechen der Parameter

Aktion/Reaktion.

Intelligenz

verstehen wir

im allgemeinen als die übergeordnete Fähigkeit, die sich in der Erfassung

und Herstellung anschaulicher und abstrakter Beziehungen äußert, dadurch

die Bewältigung neuartiger Situationen durch problemlösendes (gelerntes)

Verhalten ermöglicht und somit Versuch-und-Irrtum-Verhalten (Try &

Error) und Lernen an Erfolgen, die sich zufällig einstellen, entbehrlich

macht.

Das

Try&Error Verhalten, das eine Stubenfliege an der Fensterscheibe verweilen

lässt, zu vermeiden, stellt beim Erreichen einer

künstlichen

Intelligenz

eine zentrale

Rolle dar. Digitale neuronale Netze (neuronal networks) sind bereits in

der Lage auf neue unbekannte Situationen nicht durch Probieren, sondern

durch Anwenden erlernter Regeln an bisherigen Informationen, zu reagieren

und daraus wiederum erneut Regeln abzuleiten. Haben wir also schon eine

verwendbare künstliche Intelligenz ? Im weitesten Sinn - die Lernfähigkeit

betreffend - sicherlich, doch zur Interaktivität ist weit mehr von Nöten.

Maschinen können heute allenfalls schlussfolgern, Menschen denken. Das

Denken jedoch ist das wahrhaft freie Kombinieren von wahrgenommenen Sachverhalten.

Menschen haben selbstreflektives Bewusstsein, Maschinen nicht.

Interaktivität wird oft mit der Kommunikation durch die Maschine und der perfektionierten Illusion der Realität im virtuellen Cyberspace gleichgesetzt. Die Perfektionierung einer illusorischen Umgebung geht mit der Leistungsoptimierung integrierter Schaltkreise (Chips) einher, doch das ist immer noch genauso wenig interaktiv wie das Anklicken eines Haufen Pixel. Die Integration des Menschen selbst, des virtuellen Ichs, in diese Umgebung ist heute bereits Glasfaserrealität.Das Interagieren mit einem Computerprogramm selbst bleibt jedoch bislang unerreichte Königsdisziplin. Diesen Umstand versucht man durch Paradigmen, die man multi-optional oder Multiple-Choice nennen kann, zu vertuschen.

Wenngleich

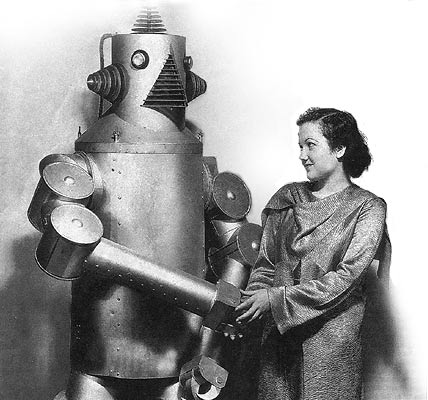

Marvin Minsky [BILD], KI Forscher und Direktor

des MIT, meinte das Problem der KI schon vor einigen Jahren gelöst zu

haben:

„Geist ist

nichts weiter als ein Produkt aus geistlosen, aber intelligent ineinander

verschachtelten Ober- und Unterprogrammen. Kein Neuron unseres Gehirns

verfügt über Intelligenz, aber im Zusammenspiel mit anderen Neuronen produziere

es Intelligenz. Also müsse es auch möglich sein, geistlose Mini-Programme

so miteinander zu verweben, daß aus ihrem Interagieren so etwas wie Intelligenz

entsteht.“ [3]

Wenn wir davon ausgehen, dass das menschliche Hirn ausschließlich aus den uns bekannten Neuronen besteht, ist Minsky’s Aussage hingehend richtig aber auch gleichermaßen banal. Ebenso ließe sich nämlich auch feststellen, dass ein Auto aus nichtfahrbaren Einzelteilen besteht. Gäbe man diese Einzelteile an unsere prähistorischen Vorfahren, wären sie theoretisch dazu in der Lage ein fahrbares Auto zu bauen. Des Dilemma ist aber, dass sie ein solches nie gesehen haben, demzufolge das - mit Minsky’s Worten „Verweben“ nicht nachvollziehen können. Im selbigen Dilemma steckt auch heute die KI Forschung.

Keine

Interaktivität – warum?

Thesen der Ursache von Interpassivität.

Das Übertragen des soziologischen Kontext auf das digitale Biotop und der Wunsch mit einer Maschine interaktiv werden zu können, zwingt uns gegebenermaßen auch dazu die Maschine als Individuum zu begreifen. Bei einer Interaktivität, also der beiderseitigen, aufeinanderberuhenden Wechselwirkung, mit der Maschine - stellt sich vornehmlich die Frage nach der Lernfähigkeit, im weiteren Sinn die Frage nach dem möglichen Vorhandensein einer künstlichen Intelligenz der Maschine.

Zwei Eckpunkte sprechen nach meiner Auffassung ganz wesentlich gegen eine Interaktivität zwischen Mensch und Maschine.

1. Erstes elementares Problem ist die geschlossene Datenstruktur nicht vernetzter „read only“ Medien, da der Datenbestand nicht erweiter- oder veränderbar ist. Ich kann also mit einer CD-ROM, deren Datenbestand auf 650MB beschränkt ist und bleibt, nicht interaktiv werden – sondern mich lediglich durch die Inhalte klicken und auf eine Entdeckungsreise begeben. Die Daten der CD-ROM sind in 10 Jahren dieselben, wie intensiv ich auch mit der Plastikscheibe arbeiten möge. Die Vergrößerung der Kapazität, beispielsweise bei DVD Medien, geben dem Benutzer allenfalls einen größeren Aktionsradius, verlängern meine „Entdeckungsreise“ und/oder perfektionieren die Qualität der Illusion. Einer künstlichen Intelligenz oder einer damit verbundenen Interaktivität kommt das wohl kaum entgegen.

2.

Gravierendes Handicap ist zum zweiten, das von Turing bis heute

versucht wird unser Intelligenzverständnis digital abzubilden.

Der Mensch ist das Original die Maschine das Duplikat. Leider wissen wir

nicht sehr viel über das Original welches wir abbilden wollen. Wir glauben

riesige Datenträger zu benötigen, um eine dem Hirn äquivalente Datenbank

aufbauen zu können. Nur Information ist nochlange kein Wissen. Die Architektur

von Mensch und Maschine ist eine grundlegend verschiedene. Während Maschinen

alles erfassen, gelingt es dem Mensch zwischen wesentlichem und unwesentlichem

zu differenzieren. Auch das menschliche Gehirn ist in seiner Datenkapazität

beschränkt, das lapidare Problem geeigneter technologischer Datenträgerkapazität

wird in Zukunft gelöst werden, vielleicht haben wir auch bereits die nötige

Kapazität, mit der Speicherung von Information in Kristallen etwa – das

elementare Problem liegt also eher in der Anordnung der Information und

der Kontrollstruktur.

Ferner unterliegt

das Gehirn einem ständigen Update und Säuberungsprozess – dem Vergessen,

welches ebenfalls auf der Differenzierung von wesentlich und unwesentlich

beruht. Maschinen hingegen können nicht vergessen – leider (?).

Die bislang erwähnenswertesten Erfolge bei der Erschaffung einer künstlichen Intelligenz, erreichte man bis heute mehr beim digitalen Abbilden abstrakter mathematischer Algorithmen – etwa dem Schachspielen, denn in einer intellektuellen Dialogfähigkeit im Sinne des Turingtest. Das Schachspiel lässt sich, wenn auch in komplexe, Regeln zerlegen. Der Rechengewalt des IBM Supercomputer „Deep Blue“, der mit 512 parallel geschalteten Schachcomputern binnen einer Sekunde ca. 200 Millionen Figurkonstellationen und 17 Halbzüge im Voraus errechnete, musste sich schon im Mai 1997 der weltbeste Spieler Garry Kasparow beugen. Der gravierende Informationsvorsprung von 8 Zügen scheint allerdings eher eine Leistung rasanter Hardwareentwicklung, als der einer Intelligenz zu sein, denn der Computer überprüft zwar Millionen von möglichen Varianten – vor allem aber die sinnlosen. Allein die Schnelligkeit garantiert den Erfolg und der Mensch hat nur bei dem was jenseits des Rechenhorizonts liegt eine Chance, etwa bei intuitiven Verhalten.

Turing’s Erben –

KI künstliche Intelligenz oder künstlicher Idiot ?

Der

britische Mathematiker Allan Mathison Turing [BILD]

(1912-1954) beschrieb 1936, entgegen dem berühmten Turing Test,

die Funktionsprinzipien einer idealen bzw. universellen Rechenmaschine.

Turing zeigte auf, wie sich komplexe Rechenvorgänge in eine Folge kleinster

und einfachster Schritte zerlegen lassen, die man als Algorithmen begreifen

kann. Wenn man geeignete Arbeitsschritte entwickelt, so Turing, lassen

sich alle lösbaren Rechnungen mit einer Turingmaschine ausführen. Mehr

noch wies Turing nach, dass sich die Arbeitsprinzipien seiner Maschine,

also die Folge der zerlegten kleinsten Schritte, auch in endliche Ketten

von 0 und 1 aufspalten lassen. Turings Denkmodell war dabei wegweisend

für die Entwicklung digitaler Computer, da jeder Rechner alle deterministischen

Funktionen berechen kann, die auch eine Turingmaschine hätte lösen können

und umgekehrt. Allerdings findet man keinen streng mathematischen Beweis

für Turings formale Definition der Berechenbarkeit.

So

formulierte Alan Turing in einem späteren (1950) Aufsatz "MIND -

Computing Machinery and Intelligence" [4] ein zweites

wesentliches, aber gegensätzliches, Konzept digitaler Medien. Den nicht

unumstrittenen Turing-Test der in der Frage resultiert:

"Kann eine Maschine Äußerungen hervorbringen, die, stammten sie von einem Menschen, als Zeichen von Intelligenz angesehen werden? "

Seit

1990, wird der von Dr. Hugh Löbner und dem Cambridge Center for Behavioral

Studies initierte und mit $100.000 US Dollar dotierte Löbner Prize

[5] – einer modernen Variante des Turing Tests, vergeben. Ziel der

Competition ist, zum einen ein Programm zu entwickeln welches sich nach

einem 5-minütigem, völlig freiem und ungezwungenen Dialog mit Probanden,

als menschenähnlichstes Computersystem herausstellt (5 Minuten = Turing

Checkpoint). Zum anderen (Grand Prize) das Erreichen, einer Täuschungsquote

von 30% : 70%, („Turing’s 30:70 likelihood level of being mistaken for

a human“) so daß also mindestens 30% der Probanden das Computerprogramm

für einen Menschen halten. Die über Terminals mit den eingereichten Programmen

kommunizierenden Probanden stellt dabei eine möglichst bunte Gruppe unterschiedlicher

Bildungsgrade dar – KI-Forscher, Linguisten, Psychologen, aber auch Kinder.

Das Thema Sex oder generell der emotionale Dialoganteil spielt bei den

besten Programmen, die dennoch weit von einem wirklichen Dialog entfernt

sind eine zentrale Rolle und das nicht grundlos wie ich meine.

Computer

machen vieles besser, schneller und zuverlässiger als der Mensch, aber

wenn wir einen Fahrplanautomaten am Bahnhof nach einer guten Disco fragen,

verschlägt es ihm die Sprache. Computer sind unflexibel und können sich

nicht auf ihre menschlichen Gesprächspartner oder auf eine Situation einstellen.

Sie haben kein Bewusstsein von sich selbst (Selbstreflexion) und sind

nicht in der Lage Entscheidungen „aus dem Bauch heraus“ zu fällen, weil

sie keine körperliche Erfahrung in der Welt besitzen, kein Ich, erwachsen

aus Lebensgeschichte, keine Emotionalität. Ich bin mir sicher würde man

ein neugeborenes Baby am Chat großziehen, es würde den Turing Test nicht

bestehen - ohne Gefühl keine Intelligenz .

Dietrich

Dörner, Psychologie Professor an der Universität Bamberg und Autor des

Buches „Logik des Mißlingens“ (1989), in dem er die Schwächen menschlichen

Umgangs mit komplexen Systemen bloßlegt, beschreibt in seinem aktuellsten

Buch „Bauplan einer Seele“ den Ansatz die Künstliche Intelligenz um eine

künstliche Emotion zu erweitern. Dabei geht er konsequent auf das in der

akademischen Psychologie vorherrschende Paradigma ein, den Mensch als

informationsverarbeitendes Wesen, dessen Verarbeitungs- und Speichertätigkeiten

durch Wenn-dann-Regeln (Ursache-Wirkung) definiert sind, zu begreifen.

Sicherlich ist die von Dörner am Reißbrett entworfene Seelenmaschine,

wie seiner Zeit Charles Babbage’s ersten programmierbaren Maschine „Analytical

Engine (1822) [BILD], ferne Fiktion – aber

manchmal sind die gedachten Maschinen ebenso einflußreich wie die tatsächlich

gebauten.

[ Mensch ] <=> [ Maschine ] <=>

[ Mensch ]:

Die

Vernetzung von Menschen führt dazu, das Interaktion einerseits wieder

im klassisch psychologischen Sinn, der Wechselwirkung innerhalb einer

Gruppe, verstanden wird. Andererseits führt der Einfluß der Maschine als

Bindeglied zu einem Bedeutungswandel von Interaktivität und angrenzender

Begrifflichkeiten, die so im rein soziologischem Kontext nie aufgetreten

sind.

Das Biotop dieser

Gruppe hat sich gewandelt und heißt ab nun Cyberspace. Kulturen, sozialer

Status oder geographische Grenzen sind in dieser Gruppe vernetzter Menschen

nichtig. Im Revier der zeitunabhängigen, weltweiten Verfügbarkeit manifestieren

sich neue Grenzen entlang der Soft- und Hardware. Sozialer Status wandelt

sich in Prozessor- und Zugangsgeschwindigkeit – Kultur in Softwareideologie

irgendwo zwischen Linux & Windows, zwischen Netscape und Microsoft

Explorer und Identität wird zur Seriennummer, zur email, zum Nickname

und zur URL.

neue Technologie - neue Kunst ?

Interaktive Kunst wird erst durch die Aktion des Publikums zur Kunst –

dieser „Merksatz“, ist dann aber auch schon einziges kontinuierliches

Merkmal an der sich interaktive Kunst im Wandel der Zeit „dingfest“ machen

lässt.

Wenngleich ich den Einfluß der Künste in der technologischen Wissensschlacht

der Interaktivität als marginal sehe, so kann man dennoch nicht behaupten

(Medien)kunst wäre nicht zeitgemäß – zeigt sie doch immer alternative

Herangehensweisen auf. In den 60er Jahren suchte man mit sogn. „offenen

Kunstwerken“, etwa John Cage’s 4,33 Stille, Interaktivität als ein „einräumen

künstlerischer Kompetenz beim Betrachter“ zu begreifen. Eine Kompetenzverschiebung,

die im genannten Beispiel bis zur völligen Umkehrung von Produzent und

Rezipient führt.

Die Aktion des

Publikums vollzog sich bis Anfang der 90’er Jahre weitesgehend im realen

ortsgebundenen Ausstellungskontext. Eine Mensch <=>

Maschine „Interaktion“ an bisweilen monströsen Installationsapparaten.

Obgleich technischer und finanzieller Aufwand den Antikommerz, in dem

sich Kunst sonst gerne sonnt in den Schatten stellte, war und ist diese

Kunst berechtigter Maßen ausstellbar.

Mit

der Entwicklung des W-orld W-ide W-eb Anfang der 90’er Jahre, also lange

Zeit nach der Entstehung des bis dahin textbasierten Internet, wurde nun

dank möglicher multimedialer Inhalte wie Bild und Ton, das Netz auch für

die Kunst entdeckt.

Diese Netzkunst

passt auf ein kleines Stück Plastik oder kommt völlig ohne Gestalt aus

der Dose, aber nicht nur das Medium war neu, sondern auch die Interaktion

von Menschen durch Maschinen fand erneute Reflexion. Zwar wurde sie immer

wieder thematisiert, doch eher müde belächelt und als ferne Fiktion wahrgenommen,

in Chaplins „Modern Times“ (1920) etwa. Nun ist sie da – eine Kunst die

sich dem Ausstellungskontext verweigert, denn die Galerie und die Werke

sind ebenso non-stop und weltweit verfügbar – wie auch virtuell. Fast

schon skandalös dass sich diese Kunst nun auch jedermann jenseits des

klassisch elitären Publikums öffnet – doch damit muss Schluß sein, dachte

sich wohl auch Peter Weibel und versucht mit der Ausstellung „net condition“

[6] am ZKM die Musealisierung der Netzkunst. Aber man

sollte doch die Kirche im Dorf lassen, Netzkunst wird dadurch kaum galeriefähiger,

bestenfalls der Diskurs mit den Künstlern scheint die Ausstellung zu rechtfertigen.

Umgekehrt werden wir genauso wenig den Louvre meiden, weil wir die „Mona

Lisa“ nun im JPEG Format auf dem heimischen Monitor sehen können.

Tilman

Baumgärtel in einem ironischen Kommentar über „Net condition“, der zusätzlich

die Diskrepanz von Kunst und Interaktivität aufzeigt:

“Und plötzlich ist alles so normal. Es gibt ein Bistro, in dem Sandwiches

und Capuccino verkauft wird. Es gibt Aufsichtspersonal in Uniformen, das

gelangweilt zwischen den Exponaten herumsteht. Es gibt Schilder, die dem

Besucher zeigen, wo die Ausstellung weitergeht. Es gibt Führungen für

Schulklassen von Leuten mit Doktortiteln und M.A.'s. Und es gibt die Kunst,

die man zum Teil anfassen darf (da "interaktiv"), zum Teil aber

auch nicht ("da Kunst"), und Kassenschluss ist eine halbe Stunde

vor Schließung des Museums.“

[7]

Die

(interaktive) Netzkunst, muss sich in ihrem technologischen Kontext zahlreiche

Fragen gefallen lassen, nicht nur die der Interaktivität.

Wie ist mit

der digitalen Reproduzierbarkeit umzugehen, gerade wo das Open Source

Prinzip von HTML die klare Opposition zum klassisch künstlerischen Unikat

darstellt ? Das einzig unikate bleibt die Netzadresse - die URL ist der

einzig nicht reproduzierbare Teil dieser Kunstform. Dies wird nach jüngsten

Ereignissen um die Künstlergruppe etoy.com, die im Auftrag des Spieleherstellers

„etoys“ von der amerikanischen Regierung - unter Androhung gewaltiger

Geldstrafen - zur Freigabe ihrer URL gezwungen wurden, um so deutlicher.

Da erwiesenermaßen der überwiegende Teil der im Wörterbuch auffindbaren

Begriffe schon als URL vergeben ist, wird es auch nicht das letzte Beispiel

dieser Art bleiben. „The great artists of tomorrow will go underground“

verkündet uns Marcel Duchamp, sein Name und seine Identität ganz sicherlich,

doch dafür tritt die URL des „great artist“ umso mehr ins Rampenlicht

der oberweltlichen Netzwerkrealität. Nimmt man ihm diese, so nimmt man

ihm praktisch sein Gesicht und kann so ferndiagnostisch Netzkünstler „ausradieren“.

Es kann und wird Zustände, wie den der „entarteten Kunst“ im Hitlerdeutschland

geben, mit dem Unterschied des Kommerz statt der Ideologie.

Doch

damit nicht genug wird der Künstler der Zukunft wieder zu einem universal

Genie, wie dies Da Vinci gewesen ist, werden müssen will er der rasanten

Entwicklung resistent gegenübertreten und nicht im Underground vergessen

werden.

Wie tief diese

Kluft inzwischen schon ist, lässt sich für mich beispielsweise an Jeffery

Shaw’s „The Net Art Browser“ [8] vorgestellt auf der

„Net Condition“ nachvollziehen. Shaw hat nicht zuletzt durch seine Installationen

wie „The Legible City“ durchaus Rang und Namen in Szenekreisen. „The Net

Art Browser“ dagegen wirkt eher wie ein Saurier aus längst vergangenen

Zeiten. Auch wenn mit dem Namen „Net Art Browser“ die Zugehörigkeit zur

Netzkunst suggeriert werden soll, hat es wohl kaum etwas damit zutun.

Shaw ist anscheinend von unserer turbulenten Zeit überrollt wurden, ein

grausiges Schicksal was wohl viele in der ressourcenfressenden Zeitspirale

ereilen wird – will man sich nicht ständig neu erfinden oder entsagt rechtzeitig

dem barbarischen Schlachtfeld.

In

der Medienkunst ist der künstlerische Ausdruck aufs engste verknüpft mit

dem, was technisch realisierbar ist, auch wenn dies gerne verleugnet wird.

Der Einzelkünstler kann praktisch nicht mehr ohne eine Schar technischer

Assistenten bestehen. Die Wissenschaft ist natürlich komplexer als dies

zu Leonardo’s Zeiten war, und so ist ein Weg, die unabdingbaren Grenzen

die uns der Forschungsstand auferlegt zu symbolisieren sicherlich nicht

der schlechteste. Die 360° Projektion eines Parks mit dem Titel „Landscape

One“ etwa, die Dialogfähigkeit auf hohem technischen Niveau mittels perfekter

Illusion zulässt, aber dennoch in der Quintessenz sich dem Charme eines

textbasierten Adventurespiels aus der Urzeit der Computerspieleindustrie

nicht entziehen kann und wahrscheinlich auch nicht will. Fast offensichtlich

spürt man die Hand des Regisseurs - geradezu ehrlich wird Interpassivität

zum künstlerischen Ausdruck. Mir widerstrebte immer dass Kunst nicht zwingend

schön sein muss, das Kunst über das bloße Funktionieren hinausginge, und

sich damit ähnlich einer Religion in eine Metawissenschaftlichkeit zu

katapultieren versuchte. Offenbar zeigt sich Einsicht gegen diese Erhabenheit

– was nicht mit Resignation zu verwechseln ist.

Auch Igor Stromajer, Künstler und Preisträger des Netzkunstwettbewerbs

„Extension“ (1997), bemerkt nüchtern:

„Wenn man heute von Interaktion als eines der Grundprinzipien der Netzkunst

spricht, ist das falsch, denn was wir jetzt haben, ist nur die unwichtige

Oberfläche von etwas, vom dem wir uns wünschen würden, dass es eine Interaktion

ist. Ist es aber nicht. Die echte Interaktion kommt erst noch. Es wird

komplexe Verbindungen zwischen den Maschinen und uns geben. Nano-Roboter

werden sich in unserem Fleisch niederlassen, und jeder Mensch wird eine

Art wandelnder Servercomputer werden, der mit allem, was ihn umgibt, kommuniziert,

interagiert und sich verbindet, während er herumläuft.“

[9]

Der

kanadische Künstler Garnet Hertz entwickelte im Frühjahr 1997 das Webprojekt

„The Simulator“ [10], dessen grundlegende Prämisse es

war, mittels einer - für damalige Verhältnisse - aufwendigen Multiple

Choice Fotostory von über 100 Einzelbildern, die tägliche Routine eines

Individuums im Digitalen darzustellen.

Doch das Projekt entpuppt sich als weitaus tiefgründiger.

Nicht die Interaktion

mit anderen Menschen oder Maschinen, sondern die Interaktion mit dem eigenen

alltäglichen Leben zeigt auf sarkastische Weise die Parallelen von Lebens-

und Programmroutine. Die Simulation von banaler körperlicher Existenz

- dem linearem Ablauf unseres Lebensmusters, in ihrer digitalen Umkehrung

im Netz weckt Zweifel am Nutzen und Wert unserer täglichen Rituale, stellt

aber zugleich die Frage - „Ist das Leben interaktiv oder multioptional

?“

[ Maschine ] <=> [ Maschine

]:

Künstlich

sozial – Die Informatik entdeckt die Soziologie

Hermann Rothermund beschreibt Interaktivität als Dialogform des technischen Mediums und generell als die Aktivität der technischen Medien.

"Die heutige kritische Diskussion der technischen Medien gründet häufig auf einer naiven und unfruchtbaren Gegenüberstellung von Mensch und Werkzeug. So wenig, wie das Freudsche Unbewußte ein Werkzeug des Ichs ist, so wenig können wir die Medien als verlängerte Organe der Menschen betrachten (wie McLuhan [11] ). Die externen Speicher haben seit jeher ein Eigenleben, die digitale Kommunikation benötigt keine Menschen an dem einen oder anderen Ende. Das von manchen Medienavantgardisten gezeichnete Bild einer Mensch-Maschine-Kommunikation ist ein Euphemismus, handelt es sich doch eher um eine Maschine-Maschine-Kommunikation mit optionaler Schnittstelle für Menschen." [12]

Wie bereits erwähnt rührt das Mißlingen einer Interaktivität mit Maschinen

grundlegend von einem fehlendem Bewusstsein der Maschine, einem „Ich“

, aufgrund des fehlenden sozialen Kontext der Maschine selbst, her. Ähnlich

der Situation total isolierter Menschen, die nie andere Menschen in Handlungen,

etwa dem Schürsenkel zubinden, beobachten oder Kommunikation in ihrem

vollen Spektrum, etwa bei Tauben oder Blinden, erfahren konnten.

Die KI entlehnte ihre Abbildungsmethodik lange Zeit dem Individuum an

sich. Anfang der 1980‘er Jahre begannen jedoch viele KI Forscher diese

Methodik anzuzweifeln und kamen zu der Erkenntnis das menschliche Intelligenz,

so man diese denn in ihrer Abbildung als künstliche Intelligenz verstehen

will, etwas mit sozialen Fähigkeiten zu tun hat und eines der Grundprinzipien

die „Verteiltheit“ ist.

Hierbei fungierte

Marvin Minsky [Bild], seines Zeichens selbst

Pionier der klassischen KI, als Vorreiter und forderte eher sozial orientierte

Algorithmen in Parallelrechnern einzusetzen. [3]. Das

eher philosophisch basierte Fordern Minsky’s, ergänzte einer seiner Schüler

– Carl Hewitt – Mitte der 1980‘er Jahre um ein konkretes technologisches

Konzept. Hewitt stellte dabei grundlegend in Frage das Intelligenz eine

Aufgabe sei, Dinge in ihrer ganzen Komplexität zu erfassen und mögliche

Lösungswege zu entwickeln, sondern verteilte diese auf mehrere parallelarbeitende

Objekte, die er Akteure nannte. In der klassischen KI war bislang immer

nur ein System Akteur, nun wurde durch Hewitt die verteilte künstliche

Intelligenz (VKI) entdeckt, welche ihre heutige Vollendung beispielsweise

in den regelmäßigen Meisterschaften im Roboter-Fußball findet.

[13]

Wieder

war es Turing, der beide Denkmodelle, sowohl das der klassischen KI durch

seinen Turing Test, bei dem die Maschine als Einzelaktuer fungiert, als

auch das der verteilten KI in dem er seine universelle Rechenmaschine

erdachte, vorwegnahm. Turing’s universal Rechner übernimmt dabei die Rolle

des sogn. „Distributed Problem Solving“, also dem verteilten Problemlösen

auf einzelne Teilaufgaben.

Die Akteure

wie Hewitt sie bezeichnete, heißen heute Agenten, und finden beispielsweise

Anwendung bei Suchmaschinen. Statt das gesamte Web nach Informationen

für die hungrigen Datenbanken der renommierten Internet Suchmaschinen

mit einem Programm zu durchforsten, schickt man eine ganze Armee einzelner

Agenten los, die in Dialog stehen um beispielsweise nicht dieselbe Beute

auf ihrer Infojagd zumachen und gleiche Websites zu katalogisieren. Neben

der internen Kommunikation der Agenten finden sich weitere zentrale Elemente

die man als Zeichen von Intelligenz sehen kann. So funktionieren die Suchagenten

in ihrer Aufgabe ohne den Eingriff des Menschen, funktionieren also innerhalb

ihrer eigenen Autonomie und kooperieren in der Lösung ihrer gemeinsamen

Aufgabe.

Auch

bei der Maschine <=> Maschine Interaktion spaltet

sich das Lager in zwei zentrale Anschauungsmodelle. Zum einen das reaktive

Modell, indem ein Agent nach einem Reiz-Reaktions-Mechanismus auf gleiche

Reize, also beispielsweise dem Aufspüren einer Website, immer gleiche

Reaktionen produziert und zum anderen dem reflektiven Modell, welches

nach der sogn. BDI-Architektur (Believe, Desire, Intention) fungiert und

demzufolge Agenten mit Überzeugungen, Wünschen und Absichten beschreibt

die je nach innerem Zustand verschieden auf gleiche Reize reagieren können.

Es gibt bereits eine technologische Dialogform und eine Interaktivität

der Maschinen - bei der der Mensch allerdings obsolet erscheint.

Was zu bemerken bleibt...

Der Begriff „Interaktivität“ lässt sich, ob seiner Kontext-Verschleppung, nicht global unter das Skalpell des Theoretikers legen. Unsere zwischenmenschliche Interaktivität durch Maschinen zeigt bereits in Ansätzen die Werte der kommenden Epoche der Wissensgesellschaft. Die soziologische Aura dieser Interaktivität durch Maschinen wandelt sich, in unvergleichbarer Weise, entlang den technologischen Parametern. Diese Gesellschaft wird keineswegs Paradies für jedermann werden. Die Karten werden lediglich neu gemischt und in der immateriellen Infowelt werden Begrifflichkeiten wie arm und reich neu definiert.

Jede

Überlegung zu interaktiven Medien hingegen muss genau genommen mit dem

Satz enden:

Es gibt (noch)

keine Interaktion mit Maschinen. Im Gegensatz zur Kommunikation, bei der

eine Botschaft vom einen zum anderen transportiert wird, geht es bei der

Interaktion um einen beiderseitigen Austausch. An diesem Unterscheidungsmerkmal

scheitert heute jede Mensch<=> Maschine „Interaktion“,

weil sich Mensch und Maschine in ihrer „geistigen“ Aktivität auf den Unterschied

von Denken und Schlussfolgern reduzieren lassen. Bis Maschinen denken,

hat die Wissenschaft der KI noch einiges vor sich, ist jedoch bereits

auf einem Weg. Ob dies ein guter oder schlechter Weg ist, bleibt ungewiss

– solange bis uns die Maschinen vielleicht eines Tages innerhalb ihrer

eigenen Intelligenzdefinition als unlogisch, uneffektiv und unnötig, ansehen.

Der Mensch wird in seinem unermüdlichen Forschungsdrang eine wahrhaft

künstliche Intelligenz erschaffen, die ihn und die Maschine befähigt interaktiv

zu werden. Schaut man in den Spiegel, so kann man sich freilich etwas

perfekteres als den Menschen vorstellen. Der Mensch ist nicht das letzte

gekrönte Glied der evolutionären Schöpfung .

Im sozialdarwinistischen Sinn arbeiten wir angestrengt an unserem eigenen

Untergang.

Interaktivität

– Traum oder Alptraum ?

Spiv.

Stephan Schröder

Dez. 1999 – Jan. 2000

kontakt: spiv@hgb-leipzig.de

www.verybusy.org / www.spiv.de

Fassung 3 – vorübergehend endgültig.

Dieses Dokument ist

im Internet (mit Bildmaterial), unter:

http://www.verybusy.org/art-icles/2000/01/spiv.htm

zu finden.

Literaturverzeichnis:

[1]

Paul Watzlavick,, Janet H.Beavin, Don D. Jackson “Menschliche Kommunikation”,

8.unveränd. Aufl. 1980

in: S.50-53 Zur Unmöglichkeit, nicht zu kommunizieren.

[2] Peter Glaser, Magischer Hauch, SPIEGEL Spezial „Der digitale Mensch“, 1997

[3] Marvin Minsky „The Society Mind“

[4] Alan Turing, „MIND - Computing Machinery and Intelligence”, 1950 http://www.abelard.org/turpap/turpar.htm

[5] Löbner Prize, http://acm.org/~loebner/loebner-prize.htmlx

[6] net condition, http://www.zkm.de/netcondition/

[7] Tilmann Baumgärtel, “Jetzt wird aufgetischt – Netzkunst am Fließband” http://www.heise.de/tp/deutsch/inhalt/sa/3444/1.html

[8] Jeffrey Shaw, „The Netart Browser “, http://www.zkm.de/net_condition/weil/

[9] Tilman Baumgärtel im Email Interview mit Igor Stromajer,

„Kommunikation mit dem Selbst“, 20.4.1999

http://www.heise.de/tp/deutsch/inhalt/sa/3364/1.html

[10] Garnet Hertz, „The Simulator“ (1997), http://www.conceptlab.com/simulator

[11] Mc Luhan, Die magischen Kanäle. Understanding Media. Dresden 1994, S. 349. "Der Inhalt der Presse ist eine literarische Aussage, so wie der Inhalt des Buches die Sprache ist, und der Inhalt des Films ist der Roman....."

[12] Herman Rotermund, "Verschwinden die Subjekte

im Speicher"

Der Text basiert auf einem Vortrag, der am 26.3.1996 im Kulturzentrum

Schlachthof in Bremen gehalten und in Internet Newsgroups publiziert wurde

[13] http://www.robocup.org